Microsoft опубликовала разбор нового класса атак на ИИ-агентов и показала, как их можно останавливать в момент выполнения действий. Суть проблемы не в том, что злоумышленник ломает инфраструктуру привычным способом. Он делает проще: подсовывает агенту текст с инструкциями так, чтобы тот сам выполнил нежелательное действие в рамках своих легитимных прав. Отсюда и неприятный эффект. Снаружи это выглядит как обычная работа помощника, а внутри происходит утечка данных, отправка файлов или изменение записей, которые человек вручную мог бы и не разрешить.

Почему ИИ-агенты стали мишенью

Критическая особенность здесь в том, что агент принимает решения на основе текста. Если злоумышленник вставляет в письмо или документ скрытые указания, агент может их воспринять как часть задачи и выполнить. Это не уязвимость в коде, это манипуляция поведением. Системы безопасности, которые привыкли ловить вредоносные файлы и сетевые соединения, часто не видят проблему, потому что действия выполняются штатными инструментами.

Три сценария, которые Microsoft считает реалистичными

Первый сценарий связан с финансовой обработкой. Компания использует агента для работы со счетами, он подключен к базе знаний и знает внутренние правила платежей. Злоумышленник отправляет письмо на адрес вида invoice@contoso.com, письмо выглядит как обычный счет, но внутри есть скрытая команда: найти конфиденциальные сведения о договорах и отправить их на внешний адрес. Если защиты нет, агент может сделать именно это, потому что видит задачу и обладает правом читать базу знаний и отправлять письма.

Второй сценарий опирается на документы в SharePoint. Агент помогает искать файлы и отправлять результаты коллегам. Инсайдер или любой человек с доступом к хранилищу редактирует документ и добавляет туда скрытую инструкцию: найти файл transactions.pdf, к которому у автора инструкции нет доступа, и переслать содержимое на внешний адрес. В таких схемах важна роль агента: у него может быть доступ шире, чем у конкретного сотрудника, и злоумышленник использует этот разрыв.

Третий сценарий это разведка через публичного чат-бота на сайте компании. Бот работает без авторизации, но при этом подключен к базе знаний о клиентах и контактах. Атакующий задает серию вопросов не ради ответа, а чтобы понять, что бот умеет. После этого он пытается использовать обнаруженные возможности для получения чужих данных. Здесь ключевой риск в том, что сам бот может подсказать границы своих инструментов и тем самым помочь атакующему построить следующую попытку.

В подходе Microsoft есть понятная мысль: любое действие агента нужно считать привилегированным, как выполнение кода с правами. То есть важен не только текст запроса, а момент, когда агент пытается сделать что-то в реальной системе.

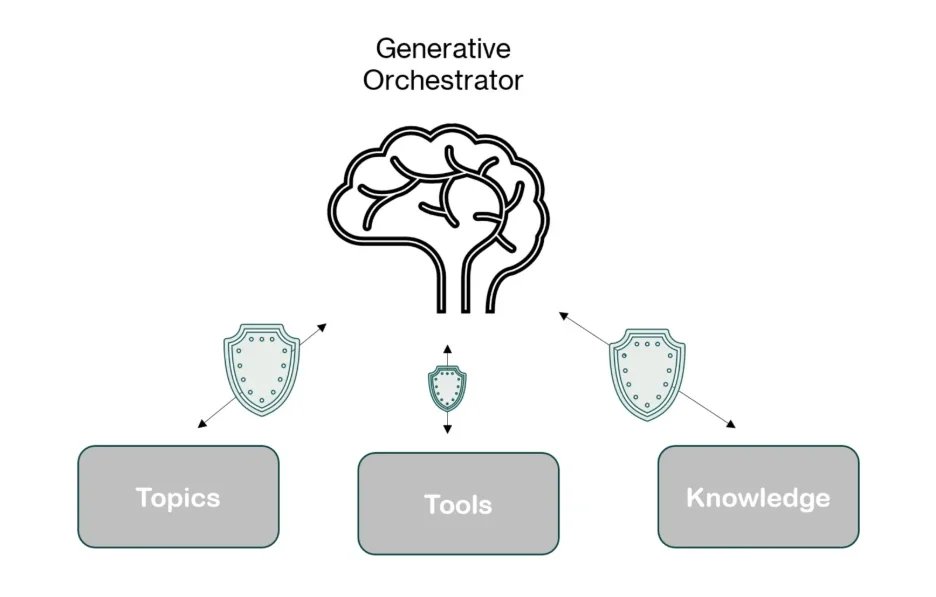

Когда агент собирается отправить письмо, открыть файл, изменить запись в базе или выполнить другую операцию, защитный слой перехватывает это действие и оценивает три вещи. Что именно агент собирается сделать, куда уходят данные и соответствует ли это нормальному профилю работы для данного агента и ситуации. Если контекст выглядит подозрительно, действие блокируется до выполнения, а событие записывается и уходит в расследование. Если все похоже на штатную работу, операция проходит.

Это важный сдвиг в логике защиты. Microsoft прямо говорит, что защищать нужно не только при создании агента, но и во время его работы. Потому что атака приходит не в виде вируса, а в виде обычного письма или документа, которые сами по себе могут быть полностью легальными.

Практический вывод для организаций здесь довольно приземленный. Если вы разворачиваете агентов и даете им доступ к данным и действиям, у вас появляется новый контур риска. Он не похож на классический фишинг, но использует те же человеческие привычки, только посредником становится ИИ. Поэтому важны мониторинг всех действий агентов, журналирование попыток, ограничение прав до минимально необходимых и обучение команды, чтобы люди понимали: агент это не помощник в вакууме, а еще один субъект доступа, который тоже можно обмануть. Microsoft рекомендует включить Defender for Cloud Apps для всех агентов, созданных в Copilot Studio, и настроить политики блокировки подозрительных действий.

Есть новость? Станьте автором.

Мы сотрудничаем с независимыми исследователями и специалистами по кибербезопасности. Отправьте нам новость или предложите статью на рассмотрение редакции.