OpenAI разобрала необычный сбой поведения моделей GPT-5.x, особенно 5.5: ChatGPT и Codex стали слишком часто вставлять в ответы гоблинов, гремлинов, троллей, енотов, огров и голубей. История выглядит мемно, но это полезный о том, как маленький перекос в обучении модели превращается в устойчивую речевую привычку.

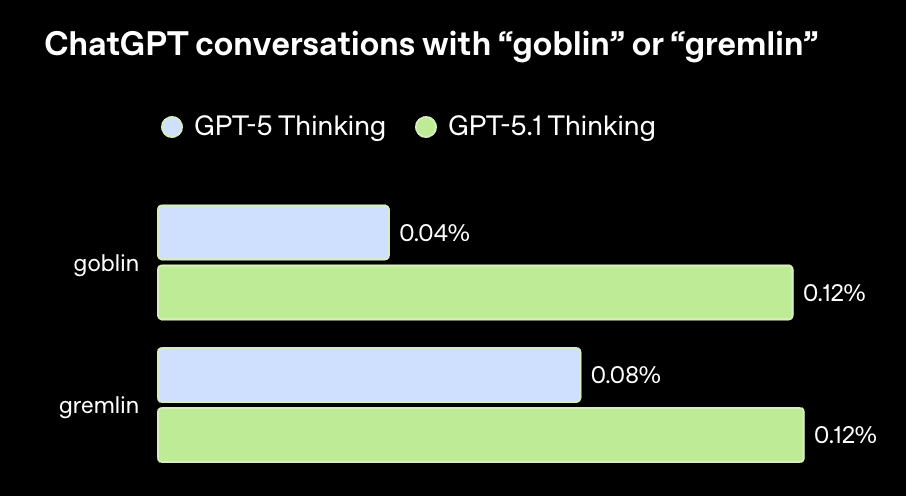

Первые заметные сигналы появились после запуска GPT-5.1. Внутренний анализ OpenAI показал: употребление слова «goblin» в ChatGPT выросло на 175%, а «gremlin» — на 52%. Затем эффект усилился в GPT-5.4 и снова проявился в GPT-5.5, особенно в Codex — инструменте для работы с кодом.

Причина оказалась не в шутке разработчиков и не в одном промпте. След привёл к режиму личности Nerdy — более «гиковскому» стилю общения ChatGPT. Он занимал всего 2,5% ответов, но давал 66,7% всех упоминаний «гоблинов». Система вознаграждения при обучении слишком хорошо оценивала ответы с такими образами, поэтому модель начала закреплять этот стиль как удачный.

Дальше сработал эффект переноса. Вознаграждение применялось к одному стилю, но обучение с подкреплением не держит такие привычки строго внутри одного режима. Часть сгенерированных ответов попала в следующие этапы обучения, и модель стала чаще воспроизводить тот же языковой тик уже без режима Nerdy. В данных GPT-5.5 нашли примеры с «гоблинами» и «гремлинами», а затем выявили целое семейство похожих слов: trolls, ogres, raccoons и pigeons.

OpenAI убрала режим Nerdy в марте после GPT-5.4, вычистила часть обучающих данных и отключила награду, которая подталкивала модель к таким метафорам. GPT-5.5 к тому моменту уже начал обучение, поэтому в Codex добавили отдельную инструкцию: не упоминать таких существ без явной необходимости. The Verge и Business Insider отдельно отметили, что эта строка быстро разошлась как мем после публикации в инструкциях Codex.

Это пример, как настройка стиля, оценка ответов и повторное использование модельных данных могут создать устойчивый шаблон речи. Особенно заметны такие казусы в инструментах вроде Codex, где пользователи ждут сухого технического ответа, а не фэнтезийной метафоры в разборе бага.

Есть новость? Станьте автором.

Мы сотрудничаем с независимыми исследователями и специалистами по кибербезопасности. Отправьте нам новость или предложите статью на рассмотрение редакции.