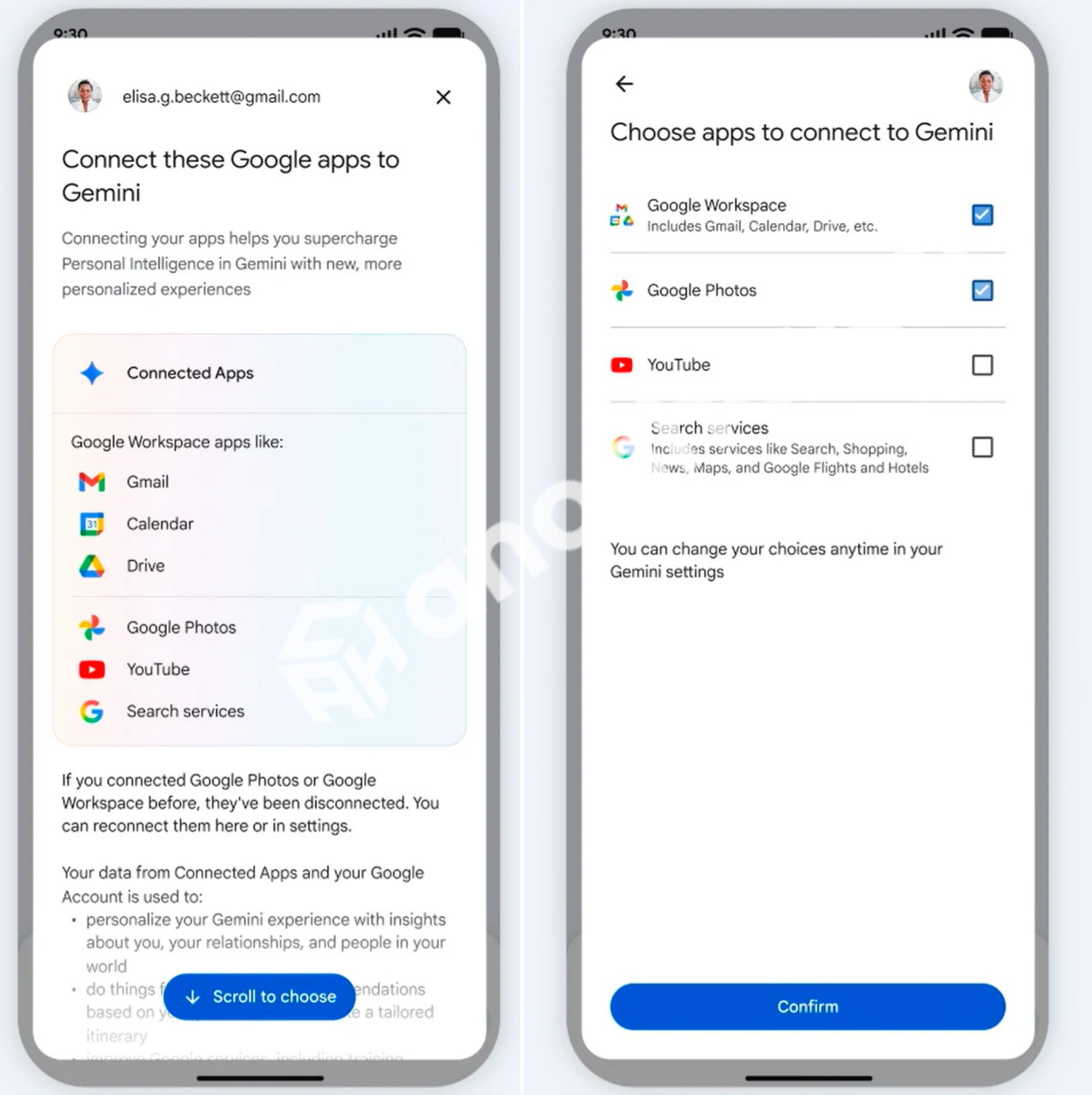

14 января 2026 Google анонсировал Personal Intelligence, новую функцию для Gemini, которая умеет собирать контекст сразу из нескольких сервисов компании. В игру идут Gmail, Google Photos, YouTube и история поиска. Идея простая: ассистент перестает быть чат-ботом, который отвечает на один запрос, и превращается в систему, которая сопоставляет разные куски вашей жизни, чтобы давать персонализированные ответы. Google называет это умением делать выводы сразу по нескольким приложениям, когда модель связывает письма, фото, поисковые запросы и просмотренные видео.

Технически это построено на моделях Gemini 3. Раньше Gemini мог подтягивать данные из отдельных приложений по запросу, но теперь он может сам соединять источники, если считает, что так ответ будет полезнее. Функция выключена по умолчанию. Пользователь сам выбирает, какие приложения подключать, и может отключить их в любой момент. По словам Google, Personal Intelligence будет включаться не на каждый вопрос, а только тогда, когда система решит, что персональный контекст реально улучшит ответ.

Запуск идет поэтапно. Сначала это бета для подписчиков Google AI Pro и AI Ultra в США, потом расширение на другие страны и на бесплатный уровень. Google также говорит, что функция скоро появится в AI Mode в поиске.

Как это выглядит в реальной жизни

Самый показательный пример привел Джош Вудворд, вице-президент Google Labs и Gemini app. Он стоял на шиномонтаже и не помнил размер шин для своего минивэна Honda. Gemini не только нашел спецификации, но и предложил варианты, что лучше для ежедневной езды и что подойдет как всесезонный выбор. А контекст для рекомендаций ассистент взял из фотографий семейных поездок в Оклахому, которые лежали в Google Photos. Дальше Вудворд попросил номер автомобиля, и Gemini вытащил его из старой фотографии. Параллельно ассистент помог подтвердить детали машины, сверившись с письмами, связанными с автомобилем.

Второй пример касается планирования путешествия. Gemini, опираясь на интересы семьи и прошлые поездки через Gmail и Photos, якобы предложил маршрут с ночным поездом, обошел типовые туристические ловушки и даже подсказал конкретные настольные игры, которые подойдут в дорогу. В таком режиме ассистент работает не как поисковая строка, а как помощник по контексту: ему не нужно объяснять, кто вы и что вы любите, он пытается восстановить это по вашим данным.

Google также показывает сценарии попроще, но показательные: рекомендации книг, сериалов, одежды и документальных фильмов на основе истории поиска и YouTube. Или просьба в духе подскажи пять YouTube-каналов под мой стиль готовки, используя чеки доставок и список продуктов из Gmail вместе с тем, что я обычно ищу и смотрю. Главная разница здесь в том, что модель не спрашивает, где искать, она сама собирает контекст.

Архитектура и риски доверия

С технической точки зрения ключевое отличие от предыдущего поколения в том, что Gemini 3 может анализировать сразу несколько источников одновременно: письма, фото и видео, а не подтягивать их по одному. Условно, ассистент может взять подтверждение бронирования из Gmail, вспомнить прошлую поездку по снимкам из Google Photos, добавить предпочтения из истории YouTube и собрать более точные рекомендации для следующего путешествия.

Google отдельно утверждает, что модель не обучается напрямую на вашем почтовом ящике или библиотеке фотографий. По их описанию, обучение идет на ваших запросах в Gemini и на ответах модели, а данные из Gmail, Photos, YouTube и поиска используются только для формирования текущего ответа, а не для обучения. Также заявлены ограничения для чувствительных тем: система не будет делать активных выводов про здоровье, но может обсуждать такие данные, если вы явно спросите.

Но даже при корректной реализации у этой идеи есть очевидные риски.

Первый риск это ошибочная персонализация. Google сам признает, что модель может связывать несвязанные вещи. Если у вас сотни фото с поля для гольфа, ассистент может решить, что вы фанат гольфа, хотя вы просто сопровождали ребенка на соревнования. Или система может неправильно понимать изменения в отношениях. Развод, расставание, смена круга общения, а модель продолжает рекомендовать рестораны для свиданий с человеком из прошлого, потому что контекст обновился у вас в голове, а не в данных.

Второй риск это ошибки в ответах. Google формулирует это прямо: Мы проверили эту бета-версию очень тщательно, чтобы свести ошибки к минимуму, но полностью их избежать не удалось. То есть ошибки будут, и пользователям предлагают использовать оценку как обратную связь.

Третий риск это приватность, и тут все упирается не в криптографию, а в доверие к компании. Включая Personal Intelligence, вы даете системе разрешение читать письма, анализировать фотографии, учитывать историю поиска и просмотр YouTube. Да, можно выбрать, какие приложения подключать. Да, можно отключить в любой момент. Но сам факт подключения означает, что ваш личный контекст становится частью механизма ответа. Это та самая граница, где удобство начинает стоить реальных данных.

Есть и практическое ограничение: пока функция не доступна для аккаунтов Google Workspace в сегментах business, enterprise и education. То есть сейчас это история для личных аккаунтов, но если механизм покажет эффективность, логично ожидать, что вопрос о внедрении в корпоративную среду тоже появится.

Personal Intelligence это логичный шаг для ассистентов: чем больше контекста, тем полезнее ответы. Но эта полезность стоит на доверии к Google как владельцу инфраструктуры, а не на модели, где ваши данные по умолчанию недоступны никому. Если вы давно живете в экосистеме Google и вам важнее удобство, функция может стать действительно сильным помощником. Если же вы сознательно уменьшаете цифровой след и стараетесь держать личные данные под контролем, это может быть той самой красной линией, после которой обратный путь становится сложнее, чем кажется.

Есть новость? Станьте автором.

Мы сотрудничаем с независимыми исследователями и специалистами по кибербезопасности. Отправьте нам новость или предложите статью на рассмотрение редакции.